Vigilância Urbana: A Nova Realidade do Rio de Janeiro até 2028

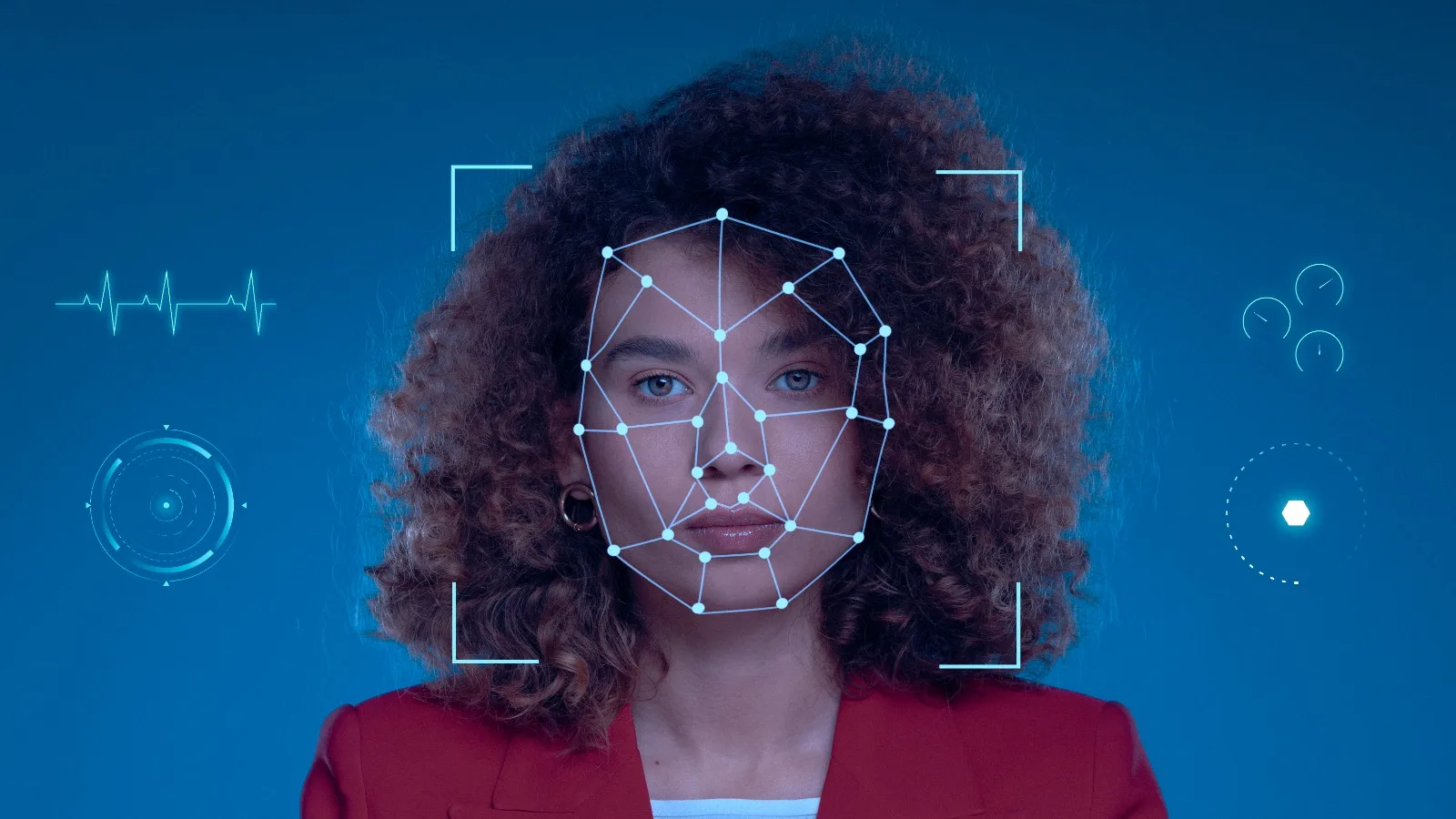

A proposta da Prefeitura do Rio de Janeiro de implantar 20 mil câmeras de reconhecimento facial até 2028 levanta preocupações sérias sobre os limites da vigilância urbana. Com essa medida, o prefeito Eduardo Paes afirma que “ninguém entra ou sai da cidade sem ser monitorado”, o que configura a ideia de um cerco digital. Essa mudança promete transformar o Rio em um ambiente altamente monitorado, suscetível a intensas discussões sobre privacidade e liberdade individual.

Anunciado como parte do projeto CIVITAS (Central de Inteligência, Vigilância e Tecnologia em Apoio à Segurança Pública), essa iniciativa visa reforçar a segurança na cidade. Embora a segurança pública seja uma prioridade importante, é fundamental que a busca por ela não comprometa os direitos fundamentais dos cidadãos, como a privacidade e a liberdade de movimento. A ansiedade em torno da segurança não pode eclipsar uma análise crítica dos métodos utilizados para alcançá-la.

As novas câmeras serão distribuídas em locais estratégicos e em áreas com grande tráfego, com o objetivo de eliminar pontos cegos. Estrategicamente posicionadas, 56 delas estarão localizadas nos limites da cidade, com tecnologia capaz de detectar comportamentos suspeitos, reconhecer rostos e veículos, além de gerar mapas de calor. Batizada de “Íris”, a inteligência artificial desenhada para essas câmeras tem o potencial de revolucionar a abordagem da segurança pública no Rio de Janeiro, ainda que levante questões cruciais sobre a definição de “suspeito”.

Um dos pontos mais críticos dessa discussão é a falta de clareza em relação ao que constitui uma “atitude suspeita”. Essa dúvida é particularmente pertinente no contexto de um Brasil com um histórico de marginalização de grupos específicos, especialmente pessoas negras e aquelas em situação de vulnerabilidade social. A ausência de critérios rigorosos pode resultar em uma criminalização ainda mais acentuada, aumentando o risco de discriminação.

Além disso, o silêncio do prefeito Eduardo Paes sobre os vieses discriminatórios associados ao reconhecimento facial é alarmante. Embora promova o sistema como um avanço tecnológico, é essencial lembrar que, em diversas partes do Brasil, houve múltiplos casos de identificação errônea envolvendo pessoas negras. A pergunta que permanece é: o que garante que as falhas observadas em outros locais não ocorrerão com a tecnologia “Íris”? Um estudo da Rede de Observatórios de Segurança destaca que cerca de 90% das pessoas equivocadamente detidas em operações de reconhecimento facial no Brasil são negras, acentuando a preocupação com um padrão de criminalização seletiva.

Ademais, a naturalização da vigilância crescente na sociedade se torna um tema preocupante. Desde reality shows até a monitoração em eventos massivos, a população gradualmente se acostuma a esses dispositivos que coletam dados pessoais. Essa aceitação sem uma análise crítica pode levar a uma diminuição da percepção dos riscos envolvidos, dificultando qualquer tipo de resistência que proteja a privacidade individual.

Casos de erros de identificação, como o do torcedor João Antônio, que foi algemado por engano em um estádio, expõem os perigos da vigilância em massa. O pedido de desculpas do governador de Sergipe na ocasião, considerando um “erro da tecnologia”, é um alívio insuficiente diante dos danos causados. Estudos têm revelado que esses incidentes não devem ser considerados meros “acidentes”, mas sintomas de um sistema que perpetua a discriminação.

O reconhecimento facial tem se revelado problemático não apenas no Brasil, mas também em outras partes do mundo. Pesquisas realizadas pelo National Institute of Standards and Technology nos Estados Unidos e pela University of Essex no Reino Unido mostraram taxas de erro significativamente mais altas nesses sistemas para pessoas não brancas.

À medida que a corrida por segurança avança, é alarmante observar que muitos governos continuam a implementar tecnologias sem comprovação de eficácia. Um levantamento realizado pelo projeto Panóptico estima que mais de 87 milhões de brasileiros estejam sob vigilância. A experiência, por exemplo, da Prefeitura de São Paulo com o sistema Smart Sampa não confirmou os benefícios esperados em relação às taxas de criminalidade.

Com este cenário, cresce o apoio a campanhas que defendem o banimento do reconhecimento facial. Iniciativas como “Ban The Scan” e “Tire Meu Rosto da Sua Mira” argumentam que, independentemente das salvaguardas ofertadas, o monitoramento em massa é uma violação dos direitos humanos. A urgência de um diálogo aberto e transparente sobre a implementação dessas tecnologias emerge como uma necessidade inadiável.

Estudos também ressaltam que os prejuízos associados ao reconhecimento facial superam qualquer benefício potencial. A tecnologia pode privar cidadãos de seu anonimato, reforçando dinâmicas de poder históricas que prejudicam a população em suas interações com a polícia.

Na contramão desse movimento, a União Europeia tem tomado medidas para garantir um uso mais responsável da inteligência artificial, criando legislação que limita a utilização de reconhecimento facial pela polícia em espaços públicos. Essa abordagem cautelosa pode servir de modelo para o Brasil.

À luz desse contexto, é crucial que a sociedade civil brasileira se engaje ativamente no debate sobre vigilância e proteção de dados, assegurando que estas discussões sejam amplas e inclusivas. O Rio de Janeiro, e o Brasil em geral, precisam de um debate profundo sobre as implicações das tecnologias de vigilância para evitar que a busca por segurança se transforme em um estado de vigilância contínua que infrinja direitos humanos essenciais.

Imagem Redação

Postar comentário